7. 엔비디아(Nvidia)

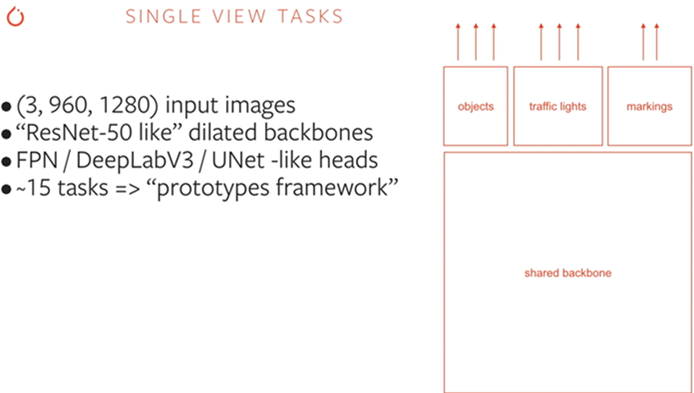

(1) 자율주행 신경망-테슬라의 HydraNet은 객체를 큰 카테고리로 분류하는 백본(Backbone) 신경망 위에 카테고리 내에서 보다 상세하게 객체를 구분하기 위한 38개의 작은 신경망으로 구성.이들 작은 신경망은 약 1,000개의 결과값, 즉 38개의 대상이 갖는 1,000개의 형태를 인식할 수 있다.

<출처 : YouTube / PyTorch>

- 이러한 HydraNet은 8개가 있으며, 이 8개의 신경망이 실시간으로 전달하는 수천개의 결과값을 통합시켜 하나의 의사결정을 도출하기 위한 또 다른 신경망(RN)이 존재

<출처 : YouTube / PyTorch>

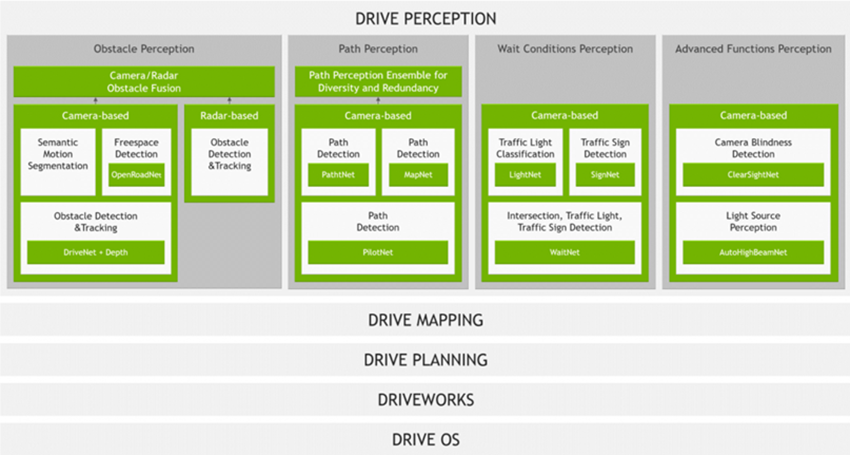

- NVIDIA도 하나의 알고리즘만으로 자율주행을 구현하는 것은 불가능하다고 설명하며 복수의 DNN(Deep Neural Network)을 이용.자율주행 연구업체가 공개하고 있는 신경망은 주로 인지 영역이며 인식 분야별로 각각 신경망을 만든 뒤 그 결과값을 통합하는 것이 현재 가장 일반적인 방법이다.

- – 하지만 위에서 설명한 것처럼 테슬라의 오토파일럿 리라이트는 PlaidNet이라는 새로운 신경망을 통해 단계를 나누지 않고 대상을 인식한 뒤 의사결정까지 한꺼번에 도출하는 구조일 것으로 추측. 오피셜은 아니지만 사실이라면 테슬라는 경쟁사 대비 여전히 앞선 상황으로 보인다.

<출처 : Nvidia>

- 장애물 인식(Obstacle Perception) – DriveNet : 차량, 보행자, 자전거 등의 객체를 감지하고 분류. 오브젝트의 움직임 예측을 위한 임시 모델도 포함

- – OpenRoadNet: 객체 주위의 운전 가능한 여유 용량 감지. 장애물이 점유한 공간과 점유하지 않은 주행가능공간을 구분하는 경계를 예측

2) 경로인식(Path Perception) – PilotNet : 인간의 운전행동을 통해 차선유지, 차선변경, 차선분할 및 병합시 주행궤적 예측

- PathNet : 차선 표시 여부와 관계없이 모든 주행 가능한 경로 및 차선 구분 구간 예측

- – MapNet : 차선, 횡단보도, 표지판 문자, 노면 화살표 표시 등 시각적 랜드마크 탐지. 경로 인식뿐만 아니라 지도 생성 및 로컬화에도 유용한 특성을 추출할 수 있다.

3) 대기상태 인식(Wait Conditions Perception) – WaitNet : 교차로와 교차로 유형, 교차로까지의 거리, 신호등, 표지판 등 차량이 정지하고 기다려야 하는 장소의 상태를 탐색

- LightNet : 신호 색상 및 방향 분류

- – SignNet : 교통표지 유형(정지, 제한속도 등) 분류

4) 고급 기능 인식(Advanced Functions Perception) – ClearSightNet : 카메라 뷰가 차단된 위치를 확인하고 그 결과 값을 깨끗, 흐림, 차단 3가지 중 하나로 분류

- AutoHighBeamNet : 업라이트 자동 제어를 위한 신호 생성

5) Multi-View LidarNet & Lidarobject Tracker-먼저 라이더로 스캔한 데이터(포인트 클라우드)를 통해 차량 주변 환경을 의미에 따라 구분(Semantic Segmentation). 그리고 라이더 데이터에 BEV(버드아이뷰, 위에서 내려다보기)도 적용해 물체를 감지하고 높낮이를 파악한다.

- 이 둘을 합쳐서 신경망에 입력. 그러면 신경망은 의미적 정보와 높낮이 정보를 기반으로 물체의 인스턴스(Instance)를 추출. 쉽게 말해 2D 라벨링 정보와 라이더 포인트 기하학 정보를 합쳐서 신경망은 3차원을 이해

- – 엔비디아는 이 같은 신경망 처리, 특히 3차원을 인식하는 데 엄청난 컴퓨팅이 필요하기 때문에 클라우드 방식으로는 한계가 있다고 설명했다. 따라서 차 안에서 대부분의 작업을 처리할 수 있는 에지 컴퓨팅 강조

- – 에지 컴퓨팅에 초점을 맞추면서 아래에 설명하는 엔비디아의 자동차 내장형 자율주행 칩만 봐도 컴퓨팅 성능이 테슬라의 FSD를 압도하며 향후 출시될 신제품은 몇 배 이상. 그만큼 가격은 수백~수 천만원대로 고가.

- – 반면 테슬라는 라이더를 사용하지 않고 2D 데이터를 통해 3차원을 이해하는 방식을 시도하고 있어 지금의 FSD 컴퓨터로도 충분할 것으로 보인다. 따라서 테슬라가 라이더를 사용하지 않는 것은 라이더다. 비용뿐만 아니라 반도체 칩과 컴퓨팅 비용까지 절감해 저렴한 가격의 범용 자율주행차를 만들기 위한 것이 아닌가 하는 생각이 든다.

(2) 소프트웨어

<출처 : Nvidia>

- DRIVEAV-DRIVEAV 소프트웨어 스택은 인식, 플래닝(의사결정), 매핑(맵) 기능 및 실제 고품질 주행 데이터로 훈련된 다양한 DNN(Deep Neural Network)을 제공

2) DRIVEIX-DRIVEIX는 혁신적인 AI콕핏 솔루션을 위한 인테리어 센싱을 제공하는 개방형 소프트웨어 플랫폼

- 운전자 및 탑승자 모니터링, AR/VR 시각화, 자동차와 탑승자 간 자연언어 상호작용을 위한 기능, DNN에 접근하는 인식 애플리케이션 제공

3) DriveWorks SDK-NVIDIA DriveWorks SDK는 DRIVEOS 외에 미들웨어 기능을 제공하는 개발자 키트

- 이들 기능은 센서 추상화 레이어(SAL)와 센서 플러그인, 데이터 레코더, 자동차 I/O 지원 및 딥뉴럴 네트워크(DNN) 프레임워크로 구성돼 있다.

4) DRIVEOS-DRIVEOS는 NVIDIVE 소프트웨어 스택의 기반으로 최초의 가속 컴퓨팅용 운영체제

- 센서 입력 처리를 위한 NvMedia, 효율적인 병렬 컴퓨팅 구현을 위한 NVIDIACUDA 라이브러리, 실시간 AI 추론을 위한 NVIDIATensorRT, 하드웨어 엔진에 액세스하기 위한 기타 개발자 도구 및 모듈로 구성

5) NVIDI ADRIVE 하이퍼ion-Hyperion(하이페리온)은 자율주행 자동차 데이터 수집 및 인식 평가 플랫폼이다. 센서, 인공지능, 자율주행, 운전자 모니터링, 시각화용 소프트웨어 스택으로 구성

- The DRIVE Hyperion 개발자 키트를 통해 개발자는 DRIVEAV 소프트웨어를 평가하고 자율주행 자동차 제품군의 데이터를 수집할 수 있다. 소프트웨어는 NVIDIA DRIVE OTA 무선 업데이트 인프라 및 서비스를 통해 DRIVE Hyperion으로 업데이트된다.

(3) 데이터 센터 인프라

- NVIDI ADGX Systems-자율주행차 구축에는 방대한 데이터가 필요. 이러한 데이터의 관리와 큐레이팅에는 고성능 컴퓨팅뿐만 아니라 지능형 트레이닝 방법도 요구된다

- – NVIDI ADGX 시스템 및 고급 훈련 도구는 대규모 신경망 훈련 간소화와 최적화 지원

2) DRIVE Constellation 시뮬레이션 플랫폼 – 자율주행 자동차가 공공도로에서 테스트하면서 가능한 모든 교통 상황을 접하는 것은 불가능하다.시뮬레이션 내부에는 수많은 가상 자동차가 일상적인 주행부터 코너 케이스, 더 위험한 상황까지 포함해 다양한 범위의 시나리오에 걸쳐 실세계보다 효율적이고 안전하게 수백만 마일을 주행할 수 있다.

- DRIVE Constellation™시뮬레이션 플랫폼은 가상 자동차의 센서 출력을 생성하는 두 개의 병렬 서버로 구성. 데이터는 AV 스택을 실행하는 DRIVEAGXAI 자동차 컴퓨터로 스트리밍되며 실시간으로 의사결정. 이후 자동차 제어 명령이 시뮬레이터에 반환

(4) 내장 칩

- NVIDIA DRIVEAG XAVER-Xavier(자비에)는 레벨 2 이상 및 레벨 3 자율주행을 위해 30TPS(초당 조단위 연산) 처리

- – XavierSoC는 서로 다른 6가지 유형의 프로세서 CPU, GPU, DLA(딥러닝 가속기), PVA(프로그래밍 가능한 비전 가속기), ISP(이미지 신호 프로세서), 스테레오/광학 흐름 가속기를 통합

2) 엔비디아 DRIVE AG XPEGAS-Pegasus(페가수스)는 2개의 Xavier SoC와 2개의 엔비디아트uring GPU를 활용하여 320TPS라는 엄청난 슈퍼컴퓨팅을 발휘(테슬라 FSD 컴퓨터 144TPS, 모빌아이 EyeQ524TPS. 대신 소비전력은 각각 다름)

- 이 플랫폼은 로보택시와 동일한 레벨4 및 레벨5 완전자율주행 시스템용

3) NVIDIA DRIVEAG X Orin-Orin(올린)은 자비에의 업그레이드 버전이라 할 수 있는 제품으로 170억개의 트랜지스터로 구성된 새로운 SoC를 기반으로 하는 플랫폼

- NVIDIA의 차세대 GPU 아키텍처 암페어(Ampere), ARM 헤라클레스(Hercules) CPU 코어, 200TPS 연산을 제공하는 새로운 딥러닝과 컴퓨터 비전 액셀러레이터를 통합해 이전 세대 자비 대비 7배 향상된 성능 구현

- – 즉 ADAS 수준의 컴퓨팅 제품이 자비에, 자비에를 활용한 완전 자율주행 수준의 제품이 페가수스, 그리고 자비에의 업그레이드 버전이 올린. 이는 다시 올린을 활용해 완전 자율주행용 플랫폼을 만들면 현재 페가수스 이상의 성능을 발휘하는 제품이 나올 수 있음을 의미한다.벤츠와 파트너십을 맺고 준비 중인 올린 기반의 완전 자율주행용 제품은 무려 2,000TPS

<출처: Forbes>

(5) 주요 사업 상황 – 볼보: DRIVEAGX Pegasus, DRIVEAV 소프트웨어 스택, DRIVEhardware-in-the-loop 시뮬레이션 플랫폼, DRIVE Constellation 제공

- 도요타: DRIVE AGXavier 또는 DRIVE AGX Pegasus, DRIVE Constellation 제공

- – 메르세데스-벤츠: DRIVE GX Orin, DRIVE 인프라, DRIVEAV 소프트웨어 스택

- – 폭스바겐 (아우디포함): DriveIX, DRIVEPX2, DriveWork, PilotNet

- – ZF:DRIVEAGXavier, DRIVEAV 소프트웨어 스택

- – 이밖에 우버, 소니, 니오, 비오니아, 현대차 등에 주요 제품 공급

8. 다임러 벤츠 & BMW (Daimler & BMW)

- 2019년 2월 다임러와 BMW는 ADAS 및 자율주행 공동개발을 통해 미래 모빌리티 서비스 업체에 약 1조3천억원 이상의 공동 투자 발표

- – 하지만 2020년 6월 이런 파트너십 중단. 공유기술 플랫폼을 만드는 데 드는 비용뿐만 아니라 현재 상황을 고려해 성공적인 협력이행을 위한 시기가 적절하지 않다고 설명했다.

- – 그러나 며칠 뒤 다임러는 엔비디아와 자율주행 협력을 발표. 오는 2024년 상용화되는 엔비디아 드라이브 AGX올린(Nvidia DriveAGX Orin) 플랫폼이 기존 ECU를 대신해 다임러 차량의 모든 제어와 정보처리를 담당할 계획이며 자동주차 기능을 포함한 모바일 앱도 함께 만들 예정이다.

- – 또 2020년 10월에는 웨이모와 자율주행 트럭 파트너십을 체결. 다임러의 플레이트라이너 카스카디아(Freightliner Cascadia) 트럭에 웨이모의 자율주행 기술을 적용해 수년 후 출시할 예정이다.

- – 이를 보면 다임러는 BMW와의 협력 및 독자 개발은 비전이 없으며 여러 자율주행 전문 업체의 솔루션을 사용할 것으로 판단한 것으로 보인다. BMW도 자체 개발보다는 결국 모빌아이에 의존하는 방향으로 가고 있다.

- – 참고로 2021년 하반기 유럽의 자율주행 규제 도입에 맞춰 다임러는 2021년형 S클래스를 시작으로 신제품 차량에 탑재할 예정인 ‘뉴 드라이브 파일럿’ 기능에 활용될 스테레오 카메라 모듈을 LG전자로부터 공급받는다. 이는 자율주행 레벨3용 카메라 모듈로 이미 2014년부터 LG전자와 스테레오 카메라 공동개발 양해각서(MOU)를 체결한 것으로 알려졌다.

<출처 : Nvidia>